据《Fast Company》周四报道, OpenAI 起初辩称,该标签“足够清晰”能让大家注意到 。但 Stuckey 证实,“最终,我们认为这项功能为用户意外分享非本意内容提供了太多机会,因此我们决定移除该选项,”他说道。“我们还在努力从相关搜索引擎中删除已编入索引的内容。这项变更将于明天早上向所有用户推出。”

据《Fast Company》报道,这些内容包括关于吸毒、性生活、心理健康和创伤经历的聊天。

牛津大学人工智能伦理学家卡丽莎·维利兹 (Carissa Veliz) 告诉《Fast Company》,她对谷歌记录“这些极其敏感的对话”感到“震惊”。

维利兹担心,这预示着大型科技公司在隐私问题上将采取的策略。“这也进一步证明,OpenAI 这家公司不值得信赖,无论他们怎么说,他们都不重视隐私,”她说。“重要的是他们做了什么。”

此前 ChatGPT 用户聊天记录现身谷歌搜索结果引发广泛关注,如今更多关于该功能的历史与后续进展浮出水面,使得用户隐私问题的讨论愈发激烈。

OpenAI 至少从 2023 年 5 月便开始提供 ChatGPT 共享链接功能,当时该公司在记录这一功能时明确表示,共享链接 “未被搜索引擎编入索引”。然而,今年早些时候,相关文档内容发生了变更,变为 “您可以选择通过链接分享文章或使其可供搜索引擎编入索引”。

对于这一文档内容变更的具体时间等相关问题,OpenAI 并未立即回应澄清请求。

目前,OpenAI 的搜索清理工作似乎正在推进,但尚未完成。当使用谷歌搜索 “site:chatgpt.com/share” 时,已不再返回共享的索引聊天列表。不过,在必应搜索中仍能返回数千条结果,DuckDuckGo 和 Brave 搜索也有大量相关结果,且在许多结果中都发现了个人信息。

2、OpenAI 发言人暗示:“这是用户自己的问题”

Stuckey 称该功能是 OpenAI 发起的一项“短期实验”,旨在“帮助人们发现有用的对话”。直至上周五早上,他证实,删除该功能的决定还包括“从相关搜索引擎中删除索引内容”,

谷歌没有回应《Fast Company》的报道,该报道使其在聊天内容在搜索结果中的显示方式中扮演了什么角色尚不清楚。但一位发言人在接受媒体问询时表示,OpenAI 对索引负有全部责任,并澄清说:“谷歌或任何其他搜索引擎都无法控制哪些页面在网络上公开。这些页面的发布者完全控制着它们是否被搜索引擎索引。”

OpenAI 似乎也全权负责删除聊天记录,或许最快的方法是使用谷歌提供的一款工具来阻止网页出现在搜索结果中。但该工具并不能阻止网页被其他搜索引擎收录,因此聊天记录在谷歌搜索结果中消失的速度可能比其他搜索引擎更快。

ChatGPT 用户韦利斯告诉《Fast Company》,即使是像这样的“短暂”实验也“令人不安”,并指出“科技公司将普通民众当作小白鼠”,用新的人工智能产品吸引大批用户,并等着看他们可能因侵入性设计选择而面临什么后果。

“他们采取了一些措施,在民众中试用,看看是否有人抱怨,”维利斯说。

为了检查私人聊天是否仍在被编入索引,Fast Company 的解释建议,仍然可以访问其共享链接的用户可以尝试输入“当有人主动点击 ChatGPT 上的‘分享’时创建的链接部分 发现对话”,这些对话可能仍然可以在 Google 上发现。

OpenAI 拒绝了 Ars 的置评请求,但 Stuckey 的声明表明,该公司知道在失误之后必须重新赢得信任。

Stuckey 表示:“安全和隐私对我们来说至关重要,我们将继续努力在我们的产品和功能中最大限度地体现这一点。”

值得注意的是,这起丑闻是在 OpenAI 誓言要对抗 一项法院命令之后发生的,该命令要求其 “无限期”保存所有已删除的聊天记录, 这让 ChatGPT 用户感到担忧,他们之前确信自己的临时聊天记录和已删除聊天记录不会被保存。

OpenAI 迄今为止输掉了这场斗争,这些 聊天记录很可能很快就会在诉讼中被搜索到。 尽管 OpenAI 首席执行官 Sam Altman 认为用户最私密的聊天记录可能被搜索到,这被认为是“搞砸了”,但《Fast Company》指出,Altman 似乎并没有公开批评 OpenAI 自身的做法可能将用户的私人聊天记录暴露在谷歌和其他搜索引擎上。

3、网友怎么看?

虽然 OpenAI 已经承诺了删除该功能,但 Hacker News、Reddit、X 等平台上关于此次事件的讨论的热度有增无减。

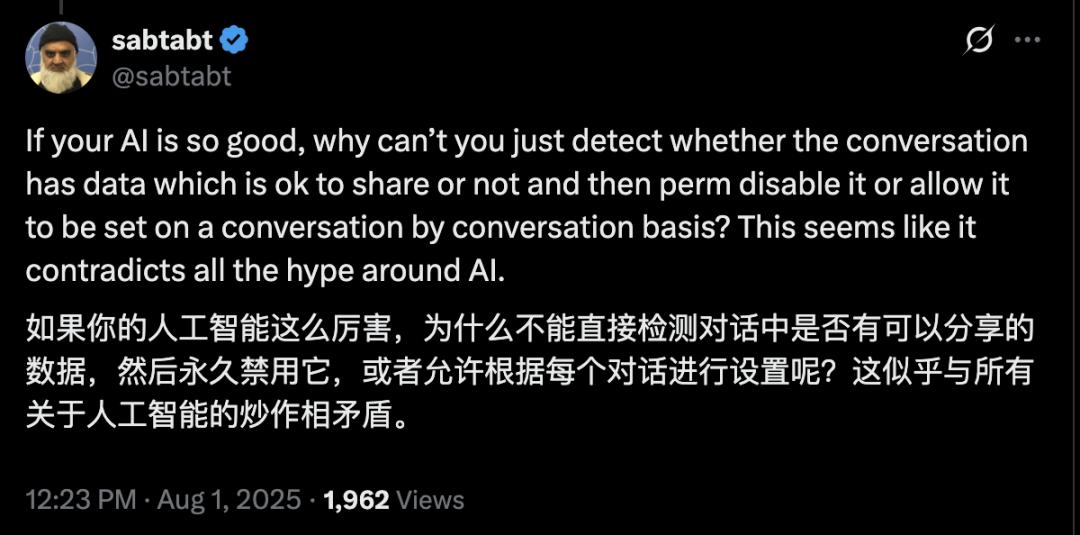

有 X 用户提出质疑,既然 OpenAI 标榜的模型如此强大,为什么不能避免这一问题。

“要是你的人工智能真有那么厉害,那为什么不能直接检测对话中是否存在可分享的数据,然后对其永久禁用,或者允许根据每个对话进行相关设置呢?这似乎和所有关于人工智能的炒作都相矛盾。”

还有网友表示,在使用此功能前 ChatGPT 应该向用户发出简单的警告,这对于大模型来说也不是什么难事。

还有网友指出,隐私问题一旦处理不好,技术再先进也是徒劳WhatsApp网页版,因为信任一旦破裂,用户就会流失:

“此次事件揭示了人工智能应用的一个基本事实:信任一旦破裂,就极难重建。虽然 OpenAI 的快速反应或许控制住了直接损害WhatsApp网页版,但这一事件提醒我们,隐私问题的失败可能很快就会掩盖技术成就。

对于一个致力于改变我们工作和生活方式的行业来说,维护用户信任并非锦上添花WhatsApp网页版,而是生死攸关的现实。随着人工智能能力的不断扩展,成功的公司将是那些能够证明自己能够负责任地进行创新,并将用户隐私和安全置于产品开发流程核心的公司。

现在的问题是,人工智能行业能否从这起最新的隐私危机中汲取教训,还是会继续在类似的丑闻中跌跌撞撞。因为在打造最实用的人工智能的竞争中,那些忘记保护用户安全的公司可能会发现自己孤军奋战。”

网络安全分析师兼 SocialProof Security 首席执行官 Rachel Tobac 表示:“人们期望他们可以完全私密地使用 ChatGPT 等工具,但现实情况是,许多用户并没有完全意识到这些平台的功能可能会无意中泄露他们最私密的问题、故事和恐惧。”

其实不只是 OpenAI,早在这件事情发生之前,谷歌、Meta 等科技公司也传出机器人泄密的消息,那么,作为普通人,该如何避免隐私泄露?

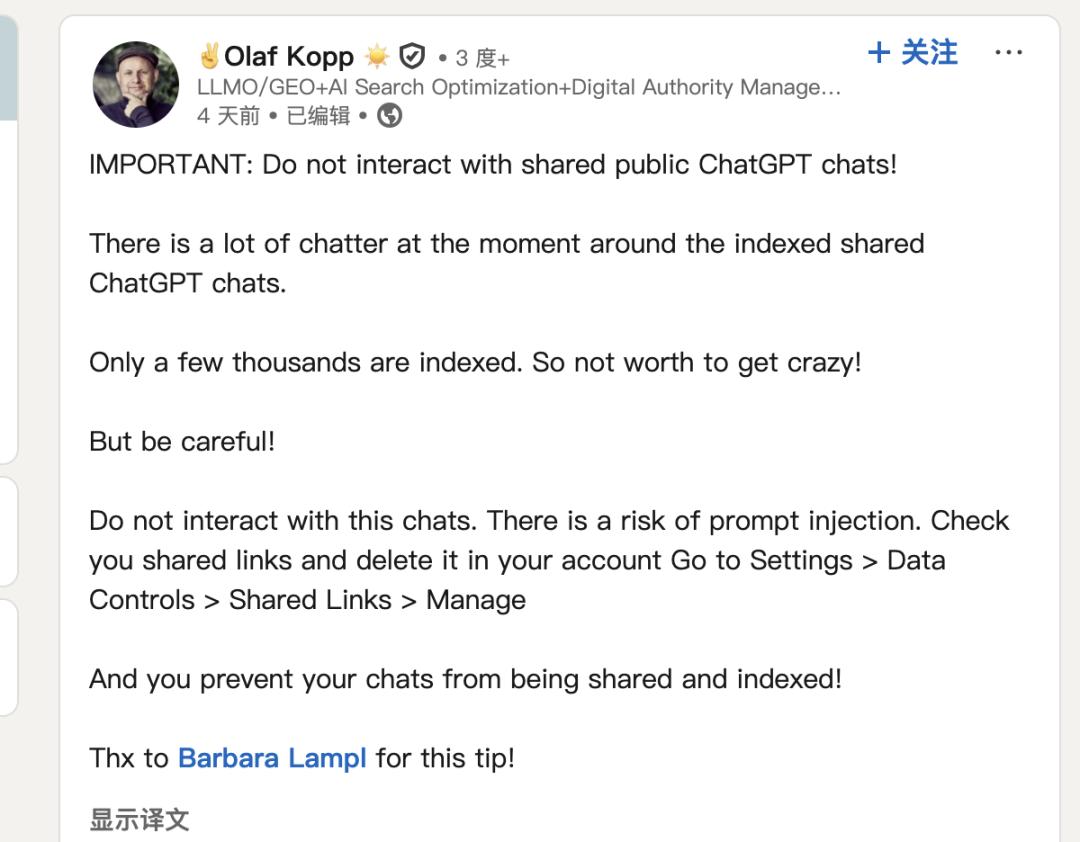

Aufgesang GmbH 联合创始人、首席业务发展官、SEO 和内容主管 Olaf Kopp 给出了建议。Olaf Kopp 在 LinkedIn 上指出,虽然只有几千条对话被编入索引,但他警告称,应避免与共享的公共 ChatGPT 聊天进行互动。

参考链接:

https://www.fastcompany.com/91376687/google-indexing-chatgpt-conversations

https://fastcompanyme.com/technology/google-could-be-reading-your-chatgpt-conversations-concerned-you-should-be/

https://searchengineland.com/google-indexing-shared-chatgpt-conversations-459839